الأخبار

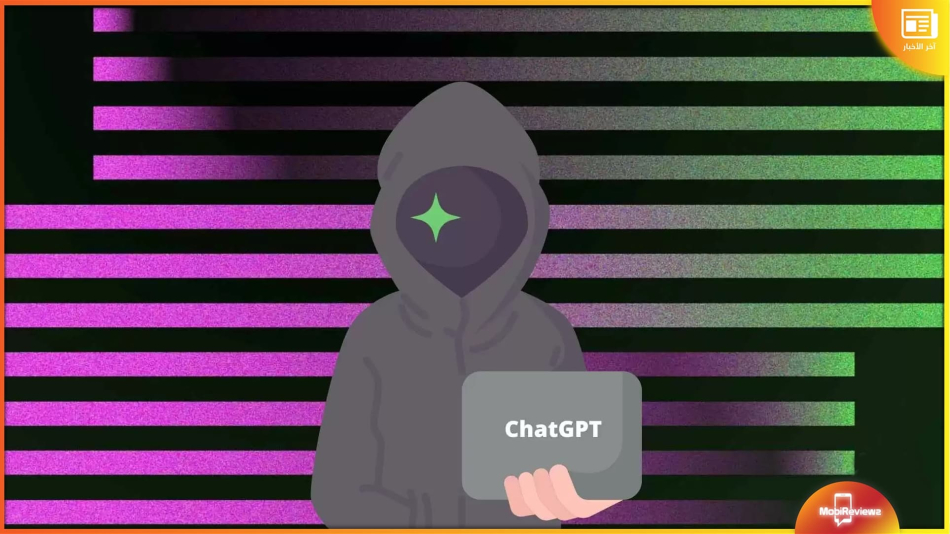

موجة جرائم الذكاء الاصطناعي: الشرطة تحذر من الجانب المظلم لـ ChatGPT

أصدرت يوروبول، وكالة تطبيق القانون في الاتحاد الأوروبي، تحذيراً يوم الاثنين بشأن إساءة الاستخدام الإجرامي المحتملة لروبوتات الدردشة المدعومة بالذكاء الاصطناعي (ChatGPT) في محاولات التصيد، وحملات التضليل، والجرائم الإلكترونية، حيث يضيف هذا التحذير إلى قائمة المخاوف المتزايدة المحيطة بالتكنولوجيا، بدءًا من القضايا القانونية إلى القضايا الأخلاقية.

أثار ChatGPT جنونًا تقنيًا منذ إطلاقه العام الماضي، مما دفع المنافسين إلى تقديم منتجات مماثلة ودفع الشركات إلى دمجها أو تقنيات مماثلة في تطبيقاتهم وخدماتهم، في أول تقرير تقني له والذي ركز على ChatGPT، حذرت وكالة Europol من أن التحسين المستمر لنماذج اللغات الكبيرة (LLMs) مثل ChatGPT يمكن أن يؤدي إلى زيادة الاستغلال من قبل المجرمين، مما يؤدي إلى مستقبل قاتم.

سلطت اليوروبول الضوء على ثلاثة مجالات رئيسية للجريمة حيث أصبح الاستخدام الضار لـ ChatGPT مصدر قلق كبير:

التصيد الاحتيالي: أشارت يوروبول إلى أن قدرة ChatGPT على إنشاء نص واقعي للغاية تجعله أداة جذابة لأغراض التصيد الاحتيالي، حيث يمكن للمجرمين استخدام قدرة الشات بوت على تقليد أنماط اللغة وانتحال أنماط الكلام لأفراد أو مجموعات معينة لاستهداف الضحايا المطمئنين.

الدعاية والمعلومات المضللة: إن قدرة ChatGPT على إنتاج نص أصلي بسرعة وعلى نطاق واسع تجعله أداة مثالية للدعاية وحملات التضليل، وأوضحت يوروبول أن التكنولوجيا تمكن المستخدمين من إنشاء ونشر الرسائل التي تعكس روايات محددة بأقل جهد.

جرائم الإنترنت: حذرت اليوروبول أيضًا من أن المجرمين ذوي المعرفة التقنية المحدودة يمكنهم استخدام ChatGPT لإنشاء تعليمات برمجية ضارة، هذا يعني أنه حتى الأفراد الذين لديهم الحد الأدنى من مهارات البرمجة يمكنهم الاستفادة من قوة ChatGPT للانخراط في أنشطة المجرمين الإلكترونيين.

يُعد تحذير يوروبول بمثابة تذكير بالأخطار المحتملة التي تشكلها تقنيات الذكاء الاصطناعي المتقدمة مثل ChatGPT على المجتمع، في حين أن هذه الابتكارات توفر العديد من الفوائد والراحة، فمن الأهمية بمكان لوكالات تطبيق القانون وواضعي السياسات ومطوري التكنولوجيا أن يتعاونوا ويضعوا ضمانات لمنع إساءة استخدام هذه الأدوات القوية من قبل المجرمين.

قد يعجبك